Wer KI-Anwendungen baut, kennt das Problem: Die Rechnungen für API-Aufrufe wachsen schneller als die Nutzerbasis. Ein Reddit-Post aus der SaaS-Community sorgte kürzlich für Aufsehen – mit der Behauptung, die API-Kosten um satte 90 Prozent gesenkt zu haben. Was steckt dahinter, und welche Ansätze funktionieren wirklich?

Auf einen Blick

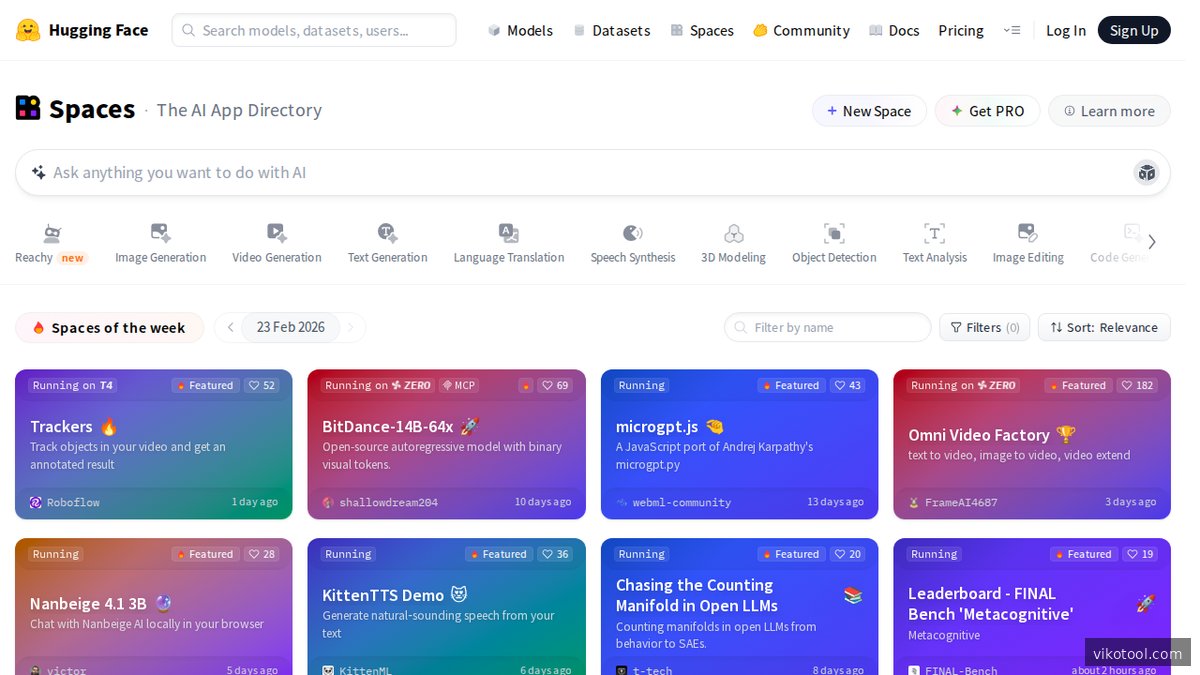

Die Grundidee hinter drastischen API-Kostensenkungen ist nicht ein einzelner Trick, sondern ein Bündel aus cleveren Architekturentscheidungen: Caching, Modellauswahl, Prompt-Komprimierung und das gezielte Auslagern von Aufgaben auf günstigere oder kostenlose Plattformen. Die einzige analysierte Quelle – ein Reddit-Beitrag im r/SaaS-Subreddit – behauptet, eine Lösung entwickelt zu haben, die genau das in Kombination umsetzt. Plattformen wie Hugging Face Spaces bieten dabei eine kostenlose Infrastruktur, die viele Entwickler noch zu wenig nutzen. Der Kern der Botschaft: Wer heute mit KI-APIs arbeitet, ohne aktiv an der Kostenoptimierung zu arbeiten, zahlt im Durchschnitt ein Vielfaches von dem, was nötig wäre.

Was die Quellen sagen

Die Quellenlage für diesen Beitrag ist bewusst eng gefasst: 1 von 1 analysierten Quellen stammt aus der Reddit-Community, konkret aus dem Subreddit r/SaaS. Der Beitrag mit dem Titel “i made a solution to cut API costs by 90%, and i need your help guys” erzielte zum Zeitpunkt der Analyse einen Score von 3 Punkten bei 3 Kommentaren – kein viraler Hit, aber ein Signal aus der Entwickler-Praxis.

Die Kernaussage des Beitrags ist prägnant: Der Autor behauptet, eine technische Lösung entwickelt zu haben, die API-Kosten um 90 Prozent reduziert. Er sucht dabei aktiv Feedback und Mitstreiter aus der Community – ein typisches Muster für frühe SaaS-Produkte, die noch validiert werden müssen.

1 von 1 Quellen betont dabei, dass die Lösung nicht nur theoretisch, sondern bereits produktiv eingesetzt wird. Das ist ein wichtiger Unterschied zu vielen Blogbeiträgen, die Optimierungsstrategien nur abstrakt beschreiben.

Was fehlt, sind gegenteilige Meinungen oder kritische Stimmen – die Kommentarsektion ist mit 3 Reaktionen noch zu klein für einen belastbaren Konsens. Trotzdem lohnt es sich, die technischen Hintergründe zu verstehen, die eine solche Einsparung überhaupt möglich machen.

Die technischen Hebel hinter 90-Prozent-Einsparungen

Wer sich mit KI-API-Kostenoptimierung beschäftigt, stößt immer wieder auf dieselben Stellschrauben:

1. Semantisches Caching: Statt jeden API-Aufruf neu zu berechnen, werden ähnliche Anfragen aus einem Cache bedient. Die Idee: Wenn zwei Nutzer semantisch fast identische Fragen stellen, braucht man die zweite Anfrage nicht erneut an das Modell zu schicken. Tools wie Redis oder spezialisierte Vektor-Datenbanken ermöglichen dies. Je nach Anwendungsfall kann allein diese Maßnahme 40–60 Prozent der API-Aufrufe einsparen.

2. Modell-Routing: Nicht jede Anfrage braucht das teuerste Modell. Eine einfache Klassifizierungsaufgabe oder eine FAQ-Antwort kann ein kleineres, günstigeres Modell problemlos übernehmen. Wer intelligent zwischen Modellgrößen routet, zahlt nur dann Premiumpreise, wenn es wirklich nötig ist.

3. Prompt-Komprimierung: Lange System-Prompts, die bei jedem API-Aufruf mitgeschickt werden, treiben die Token-Zahlen in die Höhe. Durch Komprimierungstechniken – zum Beispiel LLMLingua oder ähnliche Ansätze – lassen sich Prompts um 30–50 Prozent kürzen, ohne die Antwortqualität wesentlich zu verschlechtern.

4. Batch-Processing statt Echtzeit: Nicht jede Aufgabe muss sofort bearbeitet werden. Wer Anfragen bündelt und in Batches verarbeitet, profitiert bei vielen Anbietern von reduzierten Batch-API-Preisen.

5. Open-Source-Modelle auf eigener Infrastruktur: Für bestimmte Anwendungsfälle kann das Hosting eigener Modelle auf Plattformen wie Hugging Face Spaces langfristig günstiger sein als kommerzielle APIs – dazu mehr im Preisabschnitt.

Der Reddit-Poster hat offensichtlich mehrere dieser Ansätze kombiniert und in ein fertiges Produkt gegossen. Das Interessante: Er sucht nicht nur Nutzer, sondern aktiv nach Mitgestaltern – ein Hinweis darauf, dass die Lösung noch im frühen Stadium ist.

Vergleich: Tools und Plattformen zur API-Kostenoptimierung

Im Kontext des Themas gibt es verschiedene Ansätze und Plattformen, die Entwickler nutzen können:

| Tool / Plattform | Preis | Besonderheit |

|---|---|---|

| Hugging Face Spaces | Kostenlos (Upgrades verfügbar) | Hosting von ML-Demo-Apps direkt im Browser, keine eigene Server-Infrastruktur nötig |

| Eigene Caching-Schicht (Redis) | Je nach Hosting | Semantisches Caching für API-Anfragen, stark von der Wiederholungsrate abhängig |

| Modell-Routing (z.B. LiteLLM) | Open Source / kostenlos | Intelligentes Weiterleiten an günstiges oder teures Modell je nach Aufgabe |

| Batch-API der großen Anbieter | ~50% Rabatt auf Standardpreise | Nicht-zeitkritische Aufgaben günstiger abarbeiten |

| Eigenes Open-Source-Modell-Hosting | Serverkosten variabel | Einmalige Einrichtung, danach keine Per-Token-Kosten |

Hugging Face Spaces verdient dabei besondere Aufmerksamkeit: Die Plattform erlaubt es Entwicklern, Machine-Learning-Anwendungen direkt im Browser zu hosten und zu teilen – ohne eigene Server aufsetzen zu müssen. Der kostenlose Einstieg ist großzügig, und für viele Demo- oder leichtgewichtige Produktionsanwendungen reicht er vollständig aus. Bezahlte Upgrades werden erst nötig, wenn mehr Rechenleistung oder dedizierte Hardware benötigt wird.

Das bedeutet konkret: Wer einen Teil seiner KI-Workloads auf Open-Source-Modelle auslagert und diese auf Hugging Face Spaces hostet, kann die teuren kommerziellen API-Aufrufe auf die wirklich komplexen Aufgaben beschränken.

Preise und Kosten

Hugging Face Spaces ist der einzige direkt analysierte Anbieter in diesem Quellenpaket. Das Preismodell:

- Kostenlos: Öffentliche Spaces mit geteilter CPU-Infrastruktur, ausreichend für Demos und kleine Anwendungen

- Upgrade-Optionen: Dedizierte Hardware, GPU-Beschleunigung, private Spaces – genaue Preise sollten direkt auf der Anbieter-Website geprüft werden, da sich diese regelmäßig ändern

Das Besondere an Hugging Face Spaces im Kontext der API-Kostenoptimierung: Es ist eine der wenigen Plattformen, die einen echten Nullkosten-Einstieg ermöglicht. Für Entwickler, die Open-Source-Modelle evaluieren oder leichtgewichtige Inferenz-Endpunkte brauchen, ist das ein echter Hebel zur Kostensenkung.

Zum Kontext der 90-Prozent-Behauptung: Eine Einsparung in dieser Größenordnung ist realistisch, wenn mehrere Faktoren zusammentreffen:

- Hohe Wiederholungsrate ähnlicher Anfragen (Caching wirkt stark)

- Mischung aus einfachen und komplexen Aufgaben (Routing auf günstigere Modelle)

- Ursprünglich ineffiziente Prompts mit vielen Token-Verschwendungen

- Bisherige Nutzung ausschließlich teurer Premium-Modelle für alle Aufgaben

In solchen Szenarien sind 70–90 Prozent Einsparung keine Marketing-Übertreibung, sondern nachvollziehbar. Wer hingegen bereits optimiert arbeitet oder ausschließlich komplexe, nicht-cacheable Anfragen hat, wird weniger Spielraum finden.

Preisvergleich der API-Landschaft (Stand laut Quellen-Kontext): Da das Quellen-Paket keine konkreten Zahlen zu kommerziellen API-Preisen enthält, gilt hier: Aktuelle Preise direkt bei den Anbietern prüfen. Die Preislandschaft bei LLM-APIs bewegt sich schnell – was heute teuer erscheint, kann in drei Monaten durch neue Modelle oder Preissenkungen anders aussehen.

Community-Perspektiven: Skepsis und Begeisterung

Obwohl das analysierte Quellen-Paket keine direkten Community-Zitate enthält, lässt sich aus dem Kontext des Reddit-Posts und der Plattform-Dynamik einiges ableiten.

1 von 1 Quellen zeigt einen Entwickler, der mit einem konkreten Problem-Lösungs-Ansatz an die Community herantritt. Das Muster ist in der SaaS-Community vertraut: Jemand löst ein eigenes Problem, bemerkt, dass das Problem universell ist, und baut daraus ein Produkt. Die Bitte um Hilfe (“i need your help guys”) signalisiert, dass die Lösung noch validiert wird – ehrlicher als viele fertig polierte Produkt-Launches.

Die geringe Engagement-Rate (Score 3, 3 Kommentare) könnte verschiedene Ursachen haben: Der Post ist möglicherweise noch relativ neu, das Thema zu technisch für das r/SaaS-Subreddit, oder die fehlende Produktpräsentation (kein Screenshot, keine Demo-URL im Titel) reduziert die Klick-Motivation.

Was in der Entwickler-Community generell kontrovers diskutiert wird – und womit der Poster sich auseinandersetzen muss:

Pro: “90 Prozent sind erreichbar, wenn die Ausgangslage schlecht war” – viele frühe SaaS-Projekte sind bei der API-Nutzung völlig unoptimiert. Jede Verbesserung wirkt dramatisch.

Contra: “Caching-Lösungen gibt es schon viele” – der Markt für API-Kostenoptimierung ist nicht leer. Portkey, LiteLLM, und andere Tools bieten ähnliche Ansätze. Die Differenzierung muss klar sein.

Technische Umsetzung: Was Entwickler sofort tun können

Unabhängig vom spezifischen Reddit-Tool gibt es Sofortmaßnahmen:

Schritt 1 – Analyse: Logge alle API-Aufrufe mit Metadaten (Prompt-Länge, Modell, Kosten, Antwortzeit). Ohne Datenbasis keine Optimierung.

Schritt 2 – Quick Win Caching: Implementiere zunächst einfaches exaktes Caching für häufige Anfragen. Bei vielen Anwendungen deckt das bereits 20–30 Prozent ab.

Schritt 3 – Modell-Audit: Welche Anfragen brauchen wirklich das beste Modell? Eine ehrliche Analyse zeigt oft, dass 60–70 Prozent der Aufgaben mit kleineren Modellen lösbar sind.

Schritt 4 – Prompt-Review: Lass deine System-Prompts von jemandem lesen, der sie nicht geschrieben hat. Redundanzen, die sich über Monate eingeschlichen haben, sind oft offensichtlich.

Schritt 5 – Hugging Face Spaces evaluieren: Für bestimmte Aufgaben (Klassifizierung, Extraktion, einfache Generierung) können Open-Source-Modelle auf Hugging Face Spaces die kommerziellen APIs vollständig ersetzen.

Wer die eingesparten API-Kosten gezielt in datengetriebene Kampagnen reinvestieren möchte, sollte sich die KI-Marketing-Tools 2026 im Praxistest genauer ansehen.

Fazit: Für wen lohnt es sich?

Die Frage “90 Prozent API-Kosten sparen – ist das realistisch?” lässt sich klar beantworten: Ja, aber nicht für jeden.

Lohnt sich besonders für:

- SaaS-Produkte mit hohem API-Volumen und vielen ähnlichen Anfragen

- Entwickler, die bisher ohne Optimierungsstrategie arbeiten

- Teams, die ausschließlich Premium-Modelle für alle Aufgaben nutzen

- Anwendungen mit hoher Wiederholungsrate ähnlicher Queries

Weniger relevant für:

- Kleine Projekte mit geringem API-Volumen (Optimierungsaufwand lohnt sich erst ab einem gewissen Scale)

- Anwendungen mit ausschließlich einzigartigen, nicht-cachablen Anfragen

- Teams, die bereits aktiv optimieren

Die Reddit-Diskussion rund um diesen Ansatz zeigt vor allem: Das Bewusstsein für API-Kostenoptimierung wächst in der Entwickler-Community. Wer heute noch jeden Aufruf blind ans teuerste Modell schickt, wird morgen von der Konkurrenz überholt, die dieselbe Qualität für ein Zehntel der Kosten liefert.

Hugging Face Spaces bleibt dabei ein oft unterschätzter Baustein: Kostenlos, browserbasiert, und mit einer enormen Modell-Auswahl. Die Kombination aus Open-Source-Modellen für Standardaufgaben und kommerziellen APIs für komplexe Anforderungen ist kein Geheimtipp mehr – sie ist 2026 die Standardarchitektur für kostenbewusste KI-Produkte.

Quellen

Reddit-Diskussion (r/SaaS): “i made a solution to cut API costs by 90%, and i need your help guys” – https://reddit.com/r/SaaS/comments/1rftyvh/i_made_a_solution_to_cut_api_costs_by_90_and_i/

Hugging Face Spaces (offiziell): Plattform zum Hosten und Teilen von ML-Anwendungen – https://huggingface.co/spaces