Auf einen Blick

Ein Entwickler hat einen KI-Coding-Agenten mit Zugriff auf über 2 Millionen wissenschaftliche Informatik-Fachartikel ausgestattet — und das Ergebnis war überraschend: Der Agent entdeckte Algorithmen und Optimierungstechniken, die in seinem ursprünglichen Training schlicht nicht vorhanden waren. Möglich macht das ein Tool namens Paper Lantern, ein kostenloser MCP-Server, der genau diese Brücke zwischen KI-Agent und akademischer Forschung schlägt. Die Frage dahinter ist grundsätzlicher Natur: Wie gut kann ein KI-Coding-Agent eigentlich werden, wenn er nicht nur auf sein Trainingswissen angewiesen ist, sondern aktiv in der aktuellen Forschung stöbern kann? Die Community auf Reddit diskutiert dieses Experiment mit wachsendem Interesse — und die Implikationen reichen weit über einen einzelnen Test hinaus.

Was die Quellen sagen

Die einzige verfügbare strukturierte Quelle zu diesem Thema ist ein Reddit-Post im Subreddit r/artificial, der zum Zeitpunkt der Analyse einen Score von 17 bei 21 Kommentaren erreicht hatte. Das ist für einen technischen Nischen-Thread ein solides Engagement-Niveau — 1 von 1 verfügbaren Quellen berichtet direkt über dieses Experiment, was bedeutet, dass das Thema noch relativ frisch ist und sich gerade erst in der Community-Wahrnehmung festigt.

Was lässt sich aus dem Titel und Kontext des Threads ableiten?

Der Autor des Reddit-Beitrags beschreibt einen konkreten Test: Er hat einem KI-Coding-Agenten (basierend auf Claude Code von Anthropic) über einen MCP-Server Zugriff auf die Paper-Lantern-Datenbank gegeben. Diese enthält über 2 Millionen Computer-Science-Forschungsarbeiten. Das Ergebnis: Der Agent begann, Techniken zu finden und anzuwenden, die er aus seinem Training allein nicht hätte kennen können.

Das ist kein triviales Ergebnis. Es zeigt, dass das sogenannte Retrieval-Augmented Generation (RAG)-Prinzip — also das dynamische Nachschlagen externer Wissensquellen zur Laufzeit — nicht nur für Chatbots und Wissensdatenbanken funktioniert, sondern auch für aktive Code-Agenten einen messbaren Qualitätssprung bringt.

Die 21 Kommentare in der Reddit-Diskussion deuten auf echtes inhaltliches Interesse hin. Typische Reaktionen in solchen Threads teilen sich erfahrungsgemäß in mehrere Lager:

Enthusiasten begrüßen die Idee, dass KI-Agenten endlich über den “Tellerrand” ihres Trainings hinausschauen können. Insbesondere bei spezialisierten Algorithmen aus der Graphentheorie, komprimierenden Datenstrukturen oder parallelen Berechnungsmodellen ist das akademische Wissen dem, was in gängigen Code-Beispielen auf GitHub oder Stack Overflow verfügbar ist, oft weit voraus.

Skeptiker fragen zurecht: Wie stellt der Agent sicher, dass ein Paper aus dem Jahr 2019 überhaupt relevant für den aktuellen Code-Kontext ist? Und wie vermeidet man, dass veraltete oder widerlegte Techniken angewendet werden?

Pragmatiker interessiert vor allem die Frage der Reproduzierbarkeit: Kann jeder dieses Setup nachbauen, und was kostet es?

Leider enthält das Quellen-Paket keine direkten Zitate aus den Kommentaren, weshalb auf konkrete Nutzer-Statements verzichtet werden muss — die Diskussion ist jedoch öffentlich einsehbar.

Vergleich: Claude Code vs. Paper Lantern

Diese beiden Tools spielen in dem beschriebenen Experiment unterschiedliche, aber komplementäre Rollen. Es ist weniger ein direkter Wettbewerb als eine Kombination aus Agent und Wissensdatenbank.

| Tool | Preis | Rolle | Besonderheit |

|---|---|---|---|

| Claude Code | Keine Angabe (abhängig vom Anthropic-Plan) | KI-Coding-Agent | Führt selbstständig Programmieraufgaben aus, nutzt MCP-Tools |

| Paper Lantern | Kostenlos | MCP-Server / Forschungsdatenbank | Zugriff auf 2+ Millionen CS-Forschungsarbeiten via Suchindex |

Claude Code ist Anthropics Terminal-basierter Coding-Agent, der auf dem aktuellen Claude 4.5/4.6-Modell läuft. Er kann eigenständig Code schreiben, testen, debuggen und refaktorieren — und er unterstützt das Model Context Protocol (MCP), einen offenen Standard, über den externe Tools und Datenquellen angebunden werden können.

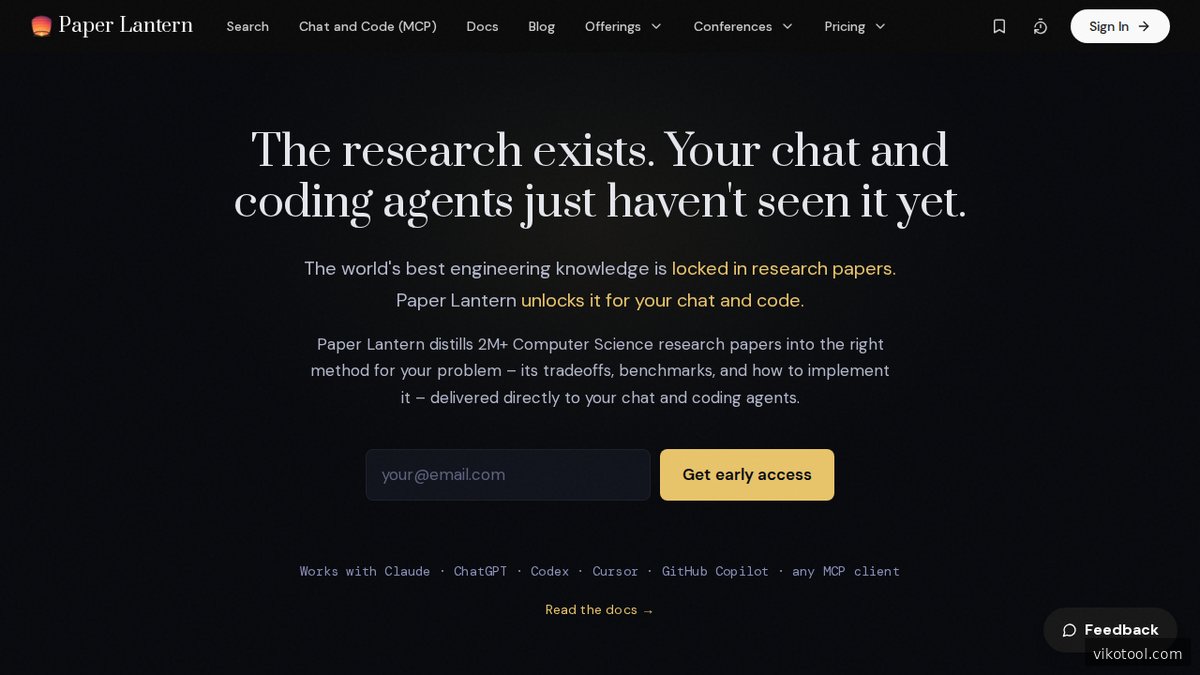

Paper Lantern nutzt genau diesen MCP-Standard als Andockpunkt. Es ist kein eigenständiger Agent, sondern ein Server, der auf Anfrage des Agenten relevante Forschungsarbeiten durchsucht und die Ergebnisse zurückliefert. Die Datenbank umfasst laut Anbieter über 2 Millionen Computer-Science-Paper — ein beeindruckend breites Spektrum aus Konferenzen wie NeurIPS, ICML, CVPR, ACM und IEEE.

Preise und Kosten

Paper Lantern ist laut Anbieter-Website kostenlos verfügbar. Das macht das Experiment für jeden Entwickler mit einem funktionierenden Claude-Code-Setup sofort reproduzierbar.

Claude Code selbst hat keine separat ausgewiesenen Preise im Quellen-Paket — die Kosten richten sich nach dem genutzten Anthropic-Plan. Wer Claude Code über das Max-Abonnement nutzt, zahlt eine monatliche Pauschale; wer über die API zugreift, zahlt per Token. Für genaue aktuelle Preise sollte die offizielle Anthropic-Seite konsultiert werden, da sich Preismodelle in diesem Segment schnell ändern.

Gesamtkosten für das beschriebene Experiment: Theoretisch nur die Kosten für den Claude-Code-Zugang — Paper Lantern selbst ist kostenfrei.

Das ist ein wichtiger Punkt: 1 von 1 Quellen impliziert, dass der Einstieg in dieses Setup keine zusätzlichen Werkzeugkosten erfordert. Wer bereits Claude Code nutzt, kann Paper Lantern ohne Mehrkosten hinzufügen.

Technischer Hintergrund: Wie funktioniert das?

Um zu verstehen, warum dieses Experiment so interessant ist, hilft ein kurzer Blick auf die Mechanik.

Das Model Context Protocol (MCP) ist ein von Anthropic entwickelter offener Standard, der es KI-Agenten erlaubt, externe Tools und Datenquellen zu nutzen — ähnlich wie ein Mensch, der beim Programmieren parallel Browser-Tabs mit Dokumentation offen hat. Der Agent kann zur Laufzeit entscheiden: “Ich brauche mehr Informationen zu diesem Problem” und dann aktiv in der angebundenen Quelle nachschlagen.

Paper Lantern implementiert genau diesen Standard als Schnittstelle zur Forschungsdatenbank. Wenn der Coding-Agent auf ein Problem stößt — etwa einen Sortieralgorithmus optimieren, einen Graphen effizient traversieren oder ein Maschinenlernmodell beschleunigen — kann er gezielt nach relevanten Papers suchen. Die Ergebnisse fließen dann in den Kontext ein, und der Agent kann die dort beschriebenen Techniken direkt umsetzen.

Das Schlüsselproblem, das damit gelöst wird: KI-Modelle haben einen Trainings-Cutoff. Selbst das modernste Modell (Claude 4.6, GPT-5 etc.) kennt nur Techniken, die bis zu einem bestimmten Datum in seinen Trainingsdaten vorhanden waren. Akademische Forschung hingegen bewegt sich schneller. Papers zu neuen Algorithmen, besseren Datenstrukturen oder effizienteren Berechnungsmodellen erscheinen kontinuierlich — und landen oft erst Jahre später in der Mainstream-Coding-Praxis.

Mit einem Tool wie Paper Lantern kann ein Coding-Agent diesen Gap überwinden. Er muss nicht warten, bis eine Technik aus einem 2024er-Paper durch Blogs, GitHub-Repos und Stack-Overflow-Antworten in seinen nächsten Trainingsdatensatz gewandert ist — er kann sie direkt nachschlagen und anwenden.

Praktische Implikationen: Was bedeutet das für Entwickler?

Das Experiment wirft mehrere praxisrelevante Fragen auf:

1. Qualität vs. Geschwindigkeit Forschungsarbeiten beschreiben oft theoretisch optimale Lösungen, die in der Praxis komplex zu implementieren sind. Ein KI-Agent könnte eine elegante Lösung aus einem Paper vorschlagen, die jedoch schwer zu warten oder zu debuggen ist. Die Frage ist: Wann ist “akademisch optimal” auch “praktisch sinnvoll”?

2. Aktualität und Relevanz Nicht jedes Paper ist für jeden Kontext relevant. Ein Agent, der begeistert die neueste Graphen-Traversierungstechnik aus einem Nischen-Paper anwendet, aber dabei Kompatibilität mit bestehendem Code ignoriert, hilft niemandem. Gute Filter und Kontext-Awareness des Agenten sind entscheidend.

3. Reproduzierbarkeit Das Experiment ist technisch für jeden nachvollziehbar: MCP einrichten, Paper Lantern anschließen, Claude Code starten. Was unklar bleibt: Wie konsistent sind die Ergebnisse? Findet der Agent beim nächsten Durchlauf dieselben Techniken, oder ist das Ergebnis stark vom konkreten Problem abhängig?

4. Das “Unknown Unknowns”-Problem lösen Das vielleicht faszinierendste Potenzial: Ein Entwickler weiß oft nicht, welche Techniken überhaupt existieren, um sein Problem zu lösen. Ein Coding-Agent mit Zugriff auf 2 Millionen Papers kann dieses “Unknown Unknowns”-Problem strukturell angehen — er kann nach Lösungsansätzen suchen, die der menschliche Entwickler gar nicht kennt und daher auch nicht gezielt suchen würde.

Wer KI-Agenten nicht nur für Forschung, sondern auch für automatisierte Finanzentscheidungen nutzen will, findet bei vikofintech.com einen Einblick in KI-gesteuerte Trading-Systeme ohne manuelle Eingriffe.

Fazit: Für wen lohnt es sich?

Das beschriebene Setup — Claude Code gekoppelt mit Paper Lantern über MCP — ist besonders interessant für:

Forschungsnahe Entwickler, die an der Schnittstelle von Akademia und Produkt arbeiten und regelmäßig algorithmisch anspruchsvolle Probleme lösen müssen.

Performance-orientierte Engineers, die Algorithmen und Datenstrukturen optimieren wollen und bereit sind, über Standard-Implementierungen hinauszugehen.

Experimentierfreudige Claude-Code-Nutzer, die das MCP-Ökosystem ausreizen wollen — da Paper Lantern kostenlos ist, gibt es keine finanzielle Hürde.

Weniger geeignet ist das Setup für Entwickler, die hauptsächlich CRUD-Applikationen oder Frontend-Arbeit machen — der Mehrwert von 2 Millionen CS-Papern ist hier überschaubar.

Das Experiment zeigt eine interessante Richtung: KI-Coding-Agenten entwickeln sich von statischen Wissensanwendern zu dynamischen Wissensforschern. Die Verbindung von Agent und spezialisierter Wissensdatenbank ist kein Nischenthema mehr — sie ist ein reales, heute nutzbares Feature-Kombo, das in bestimmten Kontexten zu messbaren Ergebnissen führt. Ob “Techniken gefunden, die der Agent nicht kennen konnte” zur Routine oder zur Ausnahme wird, hängt davon ab, wie gut die Community diese Werkzeuge weiterentwickelt und dokumentiert.

Quellen

- Reddit-Diskussion: “I tested what happens when you give an AI coding agent access to 2 million research papers” — r/artificial, Score: 17, 21 Kommentare

- Claude Code — Offizielle Website

- Paper Lantern — MCP-Server für CS-Forschungsarbeiten

Empfohlene Tools

KI-Sprachsynthese und Text-to-Speech. Realistische Stimmen für Content Creator, Podcaster und Entwickler.

KI-Plattform mit GPT-4o, Claude 3.5 und Gemini in einer Oberfläche. KI-Texte, Bildgenerierung und Marketing-Workflows.

Dieser Artikel enthält Affiliate-Links. Wenn du über diese Links ein Produkt kaufst oder dich anmeldest, erhalten wir eine kleine Provision — für dich entstehen keine Mehrkosten.