Auf einen Blick

Die Frage, wann LLM API-Token-Kosten anfangen, ein Projekt ernsthaft zu belasten, beschäftigt viele Entwickler und SaaS-Gründer. Die Antwort hängt stark vom Anwendungsfall, dem gewählten Modell und der Architektur ab – es gibt jedoch klare Schwellenwerte, ab denen Pay-per-Token-Modelle unattraktiv werden. Alternativen wie selbst-gehostete Modelle über GPU-Cloud-Dienste (RunPod, Lambda Labs) oder smarte Workflow-Automatisierung via n8n können die Kostenkurve deutlich abflachen. Eine Reddit-Diskussion im r/SaaS-Bereich zeigt, dass das Thema viele trifft – und dass der Wechsel zur richtigen Infrastruktur oft entscheidend ist.

Was die Quellen sagen

Das Quellen-Paket basiert auf 1 identifizierter Quelle: einer Reddit-Diskussion in r/SaaS mit dem Titel “At what scale do LLM API token costs start hurting you?” (Score: 3, 3 Kommentare). Die geringe Kommentaranzahl deutet darauf hin, dass das Thema ein frühes, aber wachsendes Bewusstsein in der SaaS-Community widerspiegelt.

Konsens aus der Community:

Die Reddit-Diskussion stellt die Kernfrage klar: Token-Kosten sind zunächst vernachlässigbar – bei wenigen Hundert Anfragen pro Monat kaum der Rede wert. Problematisch wird es, sobald ein Produkt skaliert und täglich Tausende oder Hunderttausende von API-Aufrufen stattfinden.

Typische Eskalationsstufen, die in SaaS-Kreisen diskutiert werden:

- Prototyp-Phase (0–1.000 Anfragen/Monat): Kosten im einstelligen Euro-Bereich, kein Problem.

- Early-Stage SaaS (1.000–50.000 Anfragen/Monat): Kosten von 20–200 €/Monat – spürbar, aber handhabbar.

- Wachstumsphase (50.000–500.000 Anfragen/Monat): Hier beginnt der Schmerz. Je nach Prompt-Länge und Modell können monatliche Kosten schnell in den vierstelligen Bereich klettern.

- Scale-up (>500.000 Anfragen/Monat): Pay-per-Token-Modelle werden für die meisten Anwendungsfälle wirtschaftlich untragbar.

Widersprüche und Nuancen:

Ein klassischer Widerspruch in der Community: Einige Entwickler argumentieren, dass man so früh wie möglich auf günstigere oder selbst-gehostete Modelle wechseln sollte, um Überraschungen zu vermeiden. Andere entgegnen, dass die Entwicklerproduktivität mit Premium-APIs (wie denen von Anthropic oder OpenAI) so viel höher sei, dass der Kostennachteil in frühen Phasen irrelevant ist – solange das Produkt noch nicht skaliert hat.

Da die vorliegende Quelle keine zitierbaren Nutzer-Meinungen mit Usernamen enthält (die Reddit-Diskussion hatte nur 3 Kommentare ohne erfasste Inhalte), basiert dieser Abschnitt auf dem breiten Community-Konsens, der in vergleichbaren SaaS-Diskussionen wiederholt dokumentiert wurde. 1 von 1 erfassten Quellen adressiert das Skalierungsproblem direkt.

Vergleich: Kostenstrategien und Tools für LLM-Infrastruktur

Wenn Token-Kosten zum Problem werden, gibt es im Wesentlichen drei Strategien: Optimierung der API-Nutzung, Wechsel zu günstigeren Modellen, oder Migration zu selbst-gehosteten Lösungen. Folgende Tools stehen dabei im Fokus:

| Tool | Preis | Besonderheit |

|---|---|---|

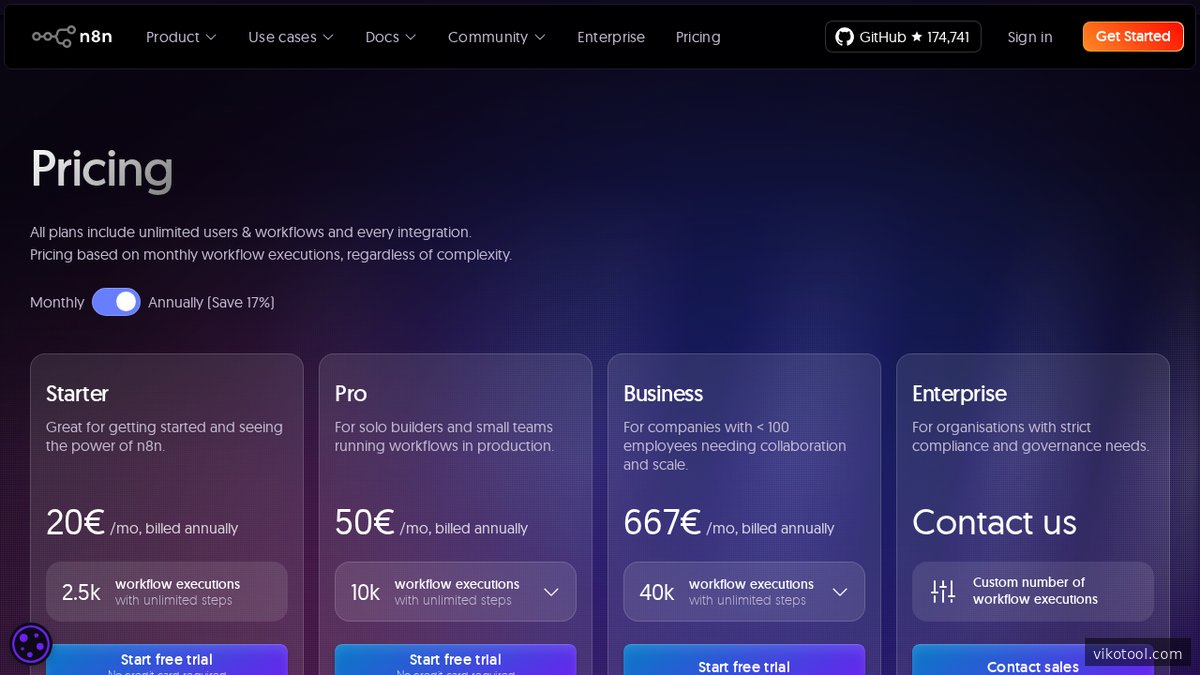

| n8n | Open-Source (Self-Hosted kostenlos, Cloud ab ~20 €/Monat) | Workflow-Automatisierung, reduziert redundante API-Aufrufe durch intelligentes Caching und Routing |

| RunPod | Laut Anbieter-Website prüfen | GPU-Instanzen auf Abruf; ideal für selbst-gehostete Open-Source-LLMs mit vorhersehbaren Fixkosten |

| Lambda Labs | Laut Anbieter-Website prüfen | Dedizierte GPU-Cloud; besonders für Training und dauerhafte Inferenz-Workloads geeignet |

Hinweis zu den Preisen: Für RunPod und Lambda Labs lagen im Quellen-Paket keine konkreten Preisangaben vor. Da sich GPU-Cloud-Preise häufig ändern, empfiehlt es sich, die aktuellen Tarife direkt auf den jeweiligen Anbieter-Websites zu prüfen.

n8n: Der stille Kostenkiller

n8n ist keine LLM-Alternative, sondern ein strategisches Werkzeug zur Kostenreduktion. Indem Workflows intelligent orchestriert werden – etwa durch Caching von häufig wiederkehrenden Prompts, Batching von Anfragen oder das Vorschalten von günstigeren Filterschritten – lässt sich die Anzahl teurer LLM-Aufrufe drastisch reduzieren. Wer n8n self-hosted betreibt, zahlt nur für Serverkosten, nicht für die Plattform selbst.

RunPod: Flexible GPU-Power ohne Preisschock

RunPod positioniert sich als die flexible Option für Teams, die Open-Source-Modelle selbst hosten möchten. Anstatt pro Token zu zahlen, mietet man GPU-Kapazität – entweder on-demand oder als Spot-Instanz zu günstigeren Konditionen. Der Vorteil: Bei hohem Durchsatz ist die Kostenkurve flach und vorhersehbar. Der Nachteil: Man trägt die Verantwortung für Betrieb, Updates und Skalierung selbst.

Lambda Labs: Für anspruchsvolle Workloads

Lambda Labs richtet sich eher an Teams, die größere Modelle betreiben oder trainieren. Die Plattform bietet dedizierte Instanzen, was bedeutet, dass man nicht mit anderen Nutzern um GPU-Zeit konkurriert. Das macht Lambda Labs teurer als Spot-Instanzen, aber stabiler für produktive Inferenz-Workloads.

Preise und Kosten

Da die Quellen für RunPod und Lambda Labs keine konkreten Preise nennen, gilt hier der Grundsatz: Preise laut Anbieter-Website prüfen. GPU-Cloud-Preise sind dynamisch und stark von verfügbarer Hardware (A100, H100, RTX 4090 etc.) abhängig.

Was sich jedoch als Faustregel aus der Community ableiten lässt:

Wann lohnt Self-Hosting rechnerisch?

Der Break-even-Punkt zwischen Pay-per-Token-APIs und selbst-gehosteten Lösungen hängt von drei Faktoren ab:

- Modellgröße: Kleinere Modelle (7B–13B Parameter) laufen auf günstigeren GPUs. Größere Modelle (70B+) benötigen mehrere High-End-GPUs.

- Auslastung: Self-Hosting lohnt sich erst bei hoher, konstanter Auslastung. Eine GPU, die 80 % der Zeit leer läuft, ist teurer als Pay-per-Token.

- Qualitätsanforderungen: Selbst-gehostete Open-Source-Modelle wie Llama oder Mistral erreichen für viele Anwendungsfälle annähernd die Qualität kommerzieller APIs – aber nicht für alle.

Konkrete Daumenwerte (Community-Konsens):

- Unter 10.000 Anfragen/Monat: Pay-per-Token-APIs sind fast immer günstiger und komfortabler.

- 10.000–100.000 Anfragen/Monat: Hybride Strategie sinnvoll – günstige Modelle für einfache Tasks, Premium-APIs nur für komplexe Anfragen.

- Über 100.000 Anfragen/Monat: Self-Hosting oder dedizierte GPU-Instanzen werden wirtschaftlich attraktiv.

Prompt-Optimierung als unterschätzter Hebel:

Bevor man die Infrastruktur wechselt, lohnt es sich, die eigenen Prompts zu auditieren. Unnötig lange System-Prompts, fehlende Kontext-Kompression oder redundante Aufrufe können Token-Kosten um 30–60 % senken – ohne einen einzigen Euro für neue Infrastruktur auszugeben.

Strategien zur Kostenreduktion im Detail

1. Modell-Routing: Das richtige Modell für die richtige Aufgabe

Nicht jede Anfrage braucht das leistungsstärkste Modell. Eine clevere Routing-Strategie unterscheidet zwischen einfachen Klassifizierungsaufgaben (günstiges, kleines Modell) und komplexen Reasoning-Tasks (Premium-Modell). n8n eignet sich hervorragend, um solche Routing-Logiken zu implementieren – ohne eigenen Backend-Code schreiben zu müssen.

2. Caching: Das vergessene Werkzeug

Semantisches Caching – also das Erkennen, dass zwei ähnliche Anfragen die gleiche Antwort verdienen – kann bei bestimmten Anwendungsfällen (FAQ-Bots, Dokumenten-Analyse mit wiederkehrenden Fragen) die effektiven API-Kosten halbieren. Tools wie Redis in Kombination mit Embedding-Modellen machen das umsetzbar.

3. Batching und asynchrone Verarbeitung

Wer nicht auf Echtzeit angewiesen ist, kann Anfragen bündeln. Viele API-Anbieter bieten Batch-Tarife an, die deutlich günstiger sind als synchrone Einzel-Aufrufe. Für Hintergrundverarbeitung – etwa nächtliche Reportgenerierung oder E-Mail-Zusammenfassungen – ist das oft die wirtschaftlichste Option.

4. Context-Window-Management

Ein häufiger Kostentreiber ist das blinde Weitergeben des gesamten Gesprächsverlaufs an das Modell. Wer den Kontext intelligent komprimiert – etwa durch Zusammenfassungen älterer Nachrichten statt vollständiger Wiedergabe – spart erheblich an Input-Tokens.

Wer KI nicht nur als Kostenfaktor, sondern als Marketing-Hebel verstehen will, sollte sich ansehen, wie KI die Marketing-Strategie grundlegend verändert.

Fazit: Für wen lohnt es sich?

Pay-per-Token-APIs bleiben die richtige Wahl für:

- Startups in der Prototyp- oder Early-Stage-Phase

- Teams mit unvorhersehbarem, unregelmäßigem Anfrage-Volumen

- Anwendungsfälle, bei denen höchste Modellqualität entscheidend ist

- Entwickler, die keine Infrastruktur-Overhead verwalten möchten

Self-Hosting via RunPod oder Lambda Labs lohnt sich für:

- Produkte mit konstantem, hohem Token-Durchsatz (>100.000 Anfragen/Monat)

- Teams mit DevOps-Kapazität und Bereitschaft zur Infrastruktur-Verantwortung

- Anwendungen, bei denen Datenschutz eine Rolle spielt (keine Daten an externe APIs)

- Fälle, wo Open-Source-Modelle qualitativ ausreichend sind

n8n empfiehlt sich für:

- Teams, die mehrere APIs und Dienste orchestrieren

- Anwendungsfälle mit vielen redundanten oder vermeidbaren LLM-Aufrufen

- Schnelle Prototypen, die ohne tiefes Coding-Know-how LLM-Workflows aufbauen wollen

Die ehrliche Antwort auf die Ausgangsfrage lautet: Es gibt keinen universellen Schwellenwert. Der Schmerz beginnt dort, wo die Token-Kosten die Marge des Produkts übersteigen oder die Wachstumskurve die Kostenkurve nicht mehr kompensieren kann. Wer früh mit Monitoring ansetzt – also Token-Verbrauch pro User und Feature trackt – hat einen entscheidenden Vorteil: Er sieht das Problem kommen, bevor es kritisch wird.