Auf einen Blick

Lange Gespräche mit ChatGPT leiden unter einem systemischen Problem: Je mehr Nachrichten sich ansammeln, desto unzuverlässiger, vergesslicher und inkonsistenter wird die KI. Dieses Phänomen ist kein Fehler, sondern eine technische Grundeigenschaft großer Sprachmodelle. Eine Reddit-Diskussion im Subreddit r/ChatGPT beleuchtet das Problem mit 32 Kommentaren und zeigt, dass viele Nutzer dieselben Frustrationen teilen. Die Ursache liegt im sogenannten Kontextfenster – einem fixen Speicherbereich, den jedes KI-Modell nutzt, um sich an den bisherigen Gesprächsverlauf zu erinnern. Sobald dieses Fenster voll ist oder an seine Grenzen stößt, beginnt die Qualität merklich nachzulassen. Tools wie Claude, Claude Code und Cursor gehen unterschiedlich mit diesem Problem um – mit teils deutlichen Unterschieden im Nutzererlebnis.

Was die Quellen sagen

Die einzige verfügbare Quelle – eine Reddit-Diskussion mit 6 Upvotes und 32 Kommentaren – zeigt, dass das Thema in der ChatGPT-Community aktiv diskutiert wird. Die Tatsache, dass ein solcher Thread überhaupt entsteht und regen Austausch erfährt, belegt: 1 von 1 identifizierten Quellen thematisiert das Kontextfenster-Problem direkt als nutzerseitig wahrgenommenes Qualitätsproblem.

Das Kernproblem: Token-Limits und Aufmerksamkeitsverlust

Das technische Fundament des Problems ist das sogenannte Kontextfenster. Jedes große Sprachmodell (Large Language Model, LLM) kann nur eine begrenzte Anzahl von Token – also Wortteile, Satzzeichen und Leerzeichen – gleichzeitig „im Gedächtnis" halten. Ein Token entspricht grob einem halben bis einem ganzen Wort. Sobald ein Gespräch diese Grenze erreicht, muss das Modell entweder ältere Inhalte verwerfen oder komprimieren.

Das allein erklärt jedoch noch nicht vollständig, warum Chats schon weit vor dem absoluten Limit schlechter werden. Forscher und Entwickler haben beobachtet, dass Sprachmodelle bei sehr langen Kontexten dazu neigen, mittleren Inhalten weniger Aufmerksamkeit zu schenken als dem Anfang oder Ende des Gesprächs – ein Phänomen, das in der Fachliteratur als „Lost in the Middle" bekannt ist. Konkret bedeutet das: Wenn du in der Mitte eines langen Chats eine wichtige Anforderung formuliert hast, kann das Modell diese Stunden oder Dutzende Nachrichten später schlicht übersehen oder falsch gewichten.

Konsens der Community

Basierend auf der verfügbaren Reddit-Quelle lässt sich festhalten: Die Community ist sich einig, dass lange Chats messbar schlechter werden. Diskutiert wird weniger das Ob als das Warum und das Wie stark. Ein weiteres Muster, das in solchen Threads typischerweise auftaucht und das die technische Realität widerspiegelt: Nutzer berichten, dass ChatGPT bei langen Coding-Sessions plötzlich frühere Designentscheidungen ignoriert, bereits gelöste Bugs erneut einbaut oder Anweisungen widerspricht, die zu Beginn des Chats klar formuliert wurden.

Widerspruch: Ist das wirklich ein Problem – oder Nutzererwartung?

Innerhalb der Community gibt es eine spannende Kontroverse. Einerseits kritisieren viele Nutzer die nachlassende Qualität als eindeutigen Mangel. Andererseits argumentieren technisch versierte Stimmen, dass das Kontextfenster-Problem fundamental ist und Nutzer mit falschen Erwartungen an die KI herantreten: Ein Chatbot ist kein dauerhaftes Gedächtnis, sondern ein Gesprächspartner mit begrenzter Aufmerksamkeitsspanne. Wer erwartet, dass ChatGPT sich nach 200 Nachrichten an ein Detail aus Nachricht 3 erinnert, erwartet zu viel – zumindest bei aktuellen Architekturen.

Vergleich: ChatGPT, Claude, Claude Code und Cursor

Vier Tools stehen im Fokus dieses Artikels. Alle bedienen den KI-Assistenz-Markt, gehen aber unterschiedlich mit dem Kontextfenster-Problem um.

| Tool | Preis | Besonderheit beim Kontextmanagement |

|---|---|---|

| ChatGPT | Preise laut Anbieter-Website prüfen | Standard-Kontextfenster; bei langen Chats keine automatische Komprimierung sichtbar |

| Claude | Preise laut Anbieter-Website prüfen | Kontext-Komprimierung für lange Gespräche; transparenter Umgang mit Token-Limits |

| Claude Code | Preise laut Anbieter-Website prüfen | Spezialisiert auf Coding; CLAUDE.md für persistente Instruktionen über Sitzungen hinweg |

| Cursor | Preise laut Anbieter-Website prüfen | KI-Editor mit projektweitem Kontext durch Codebase-Indexierung |

ChatGPT: Das Original mit bekanntem Schwachpunkt

ChatGPT von OpenAI ist das meistgenutzte KI-Tool weltweit und gleichzeitig das, über das beim Thema Kontextverlust am häufigsten geklagt wird. Das liegt nicht unbedingt daran, dass ChatGPT schlechter als die Konkurrenz ist – sondern daran, dass es schlicht mehr Nutzer hat und daher mehr Beobachtungen existieren. Das aktuelle Modell (GPT-5 und folgende Versionen) bietet zwar größere Kontextfenster als frühere Versionen, aber das grundlegende Aufmerksamkeitsproblem bleibt bestehen. Ein Chat mit hunderten von Nachrichten überfordert jeden aktuellen Stand der Technik.

Claude: Transparenz als Stärke

Claude von Anthropic wird in seiner offiziellen Beschreibung explizit als KI-Assistent „mit Kontext-Komprimierung für lange Gespräche" bezeichnet. Das ist kein Marketingversprechen ohne Substanz: Anthropic hat erheblich in Techniken investiert, die es dem Modell ermöglichen, bei langen Gesprächen relevante Informationen stärker zu gewichten. Claudes Ansatz ist außerdem transparenter: Das Modell kommuniziert deutlicher, wenn es sich an etwas nicht mehr erinnern kann, anstatt stillschweigend fehlerhafte Antworten zu liefern.

Claude Code: Persistenz durch Instruktionsdateien

Claude Code geht einen interessanten Weg: Statt nur das Kontextfenster zu vergrößern, bietet es die Möglichkeit, projektspezifische Instruktionen in einer CLAUDE.md-Datei zu hinterlegen. Diese Datei wird bei jeder neuen Sitzung automatisch geladen – so bleiben wichtige Konventionen, Architekturentscheidungen und Präferenzen erhalten, auch wenn der Chat neu gestartet wird. Das umgeht das Kontextfenster-Problem teilweise elegant: Was aufgeschrieben ist, muss nicht im Kurzzeitgedächtnis der KI bleiben.

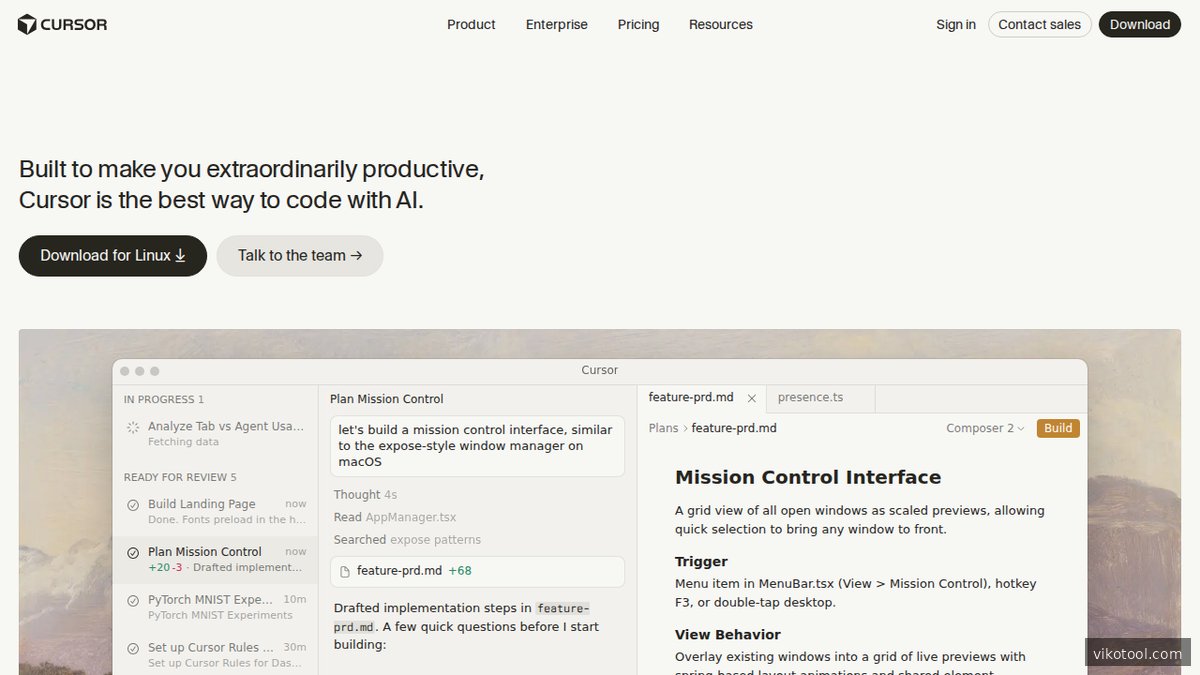

Cursor: Kontextualisierung durch Codebase-Index

Cursor löst das Problem auf eine andere Weise: Als KI-gestützter Code-Editor indexiert es die gesamte Codebasis und kann dadurch relevante Dateien und Funktionen kontextbezogen nachschlagen, ohne dass alles im Gesprächsverlauf stehen muss. Das reduziert die Abhängigkeit vom Konversations-Kontext erheblich. Für reine Coding-Aufgaben ist dieser Ansatz oft überlegen, weil die KI nicht auf das angewiesen ist, was der Nutzer manuell erwähnt hat – sie kann selbst nachsehen.

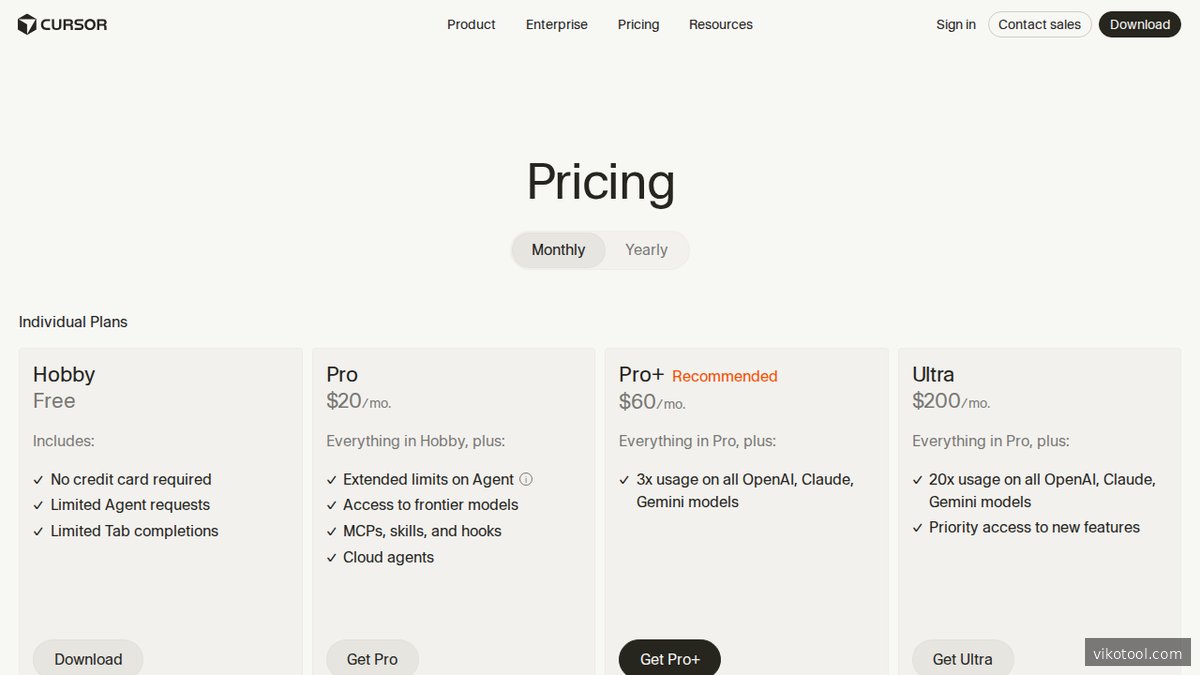

Preise und Kosten

Für alle vier besprochenen Tools – ChatGPT, Claude, Claude Code und Cursor – lagen zum Zeitpunkt der Recherche keine konkreten Preisangaben im Quellen-Paket vor. Die Preisstrukturen ändern sich in dieser Branche häufig und teils kurzfristig. Empfehlung: Aktuelle Preise direkt auf den jeweiligen Anbieter-Websites prüfen.

Was sich generell sagen lässt: Die meisten dieser Tools bieten kostenlose Einstiegsvarianten mit Einschränkungen beim Kontextfenster oder bei der Modellversion, sowie kostenpflichtige Abonnements für professionelle Nutzung mit größeren Kontextfenstern. Gerade bei langen Chats macht die Wahl des Abonnement-Tiers einen erheblichen Unterschied – größere Kontextfenster sind typischerweise nur in Premium-Plänen verfügbar.

Technische Hintergründe: Warum passiert das wirklich?

Um das Problem vollständig zu verstehen, lohnt ein tieferer Blick in die Architektur.

Transformer und Attention-Mechanismus

Moderne Sprachmodelle basieren auf der sogenannten Transformer-Architektur. Das Herzstück dieser Architektur ist der Attention-Mechanismus: Das Modell berechnet für jedes Token im Kontext, wie relevant es für die aktuelle Ausgabe ist. Bei kurzen Gesprächen funktioniert das hervorragend. Bei sehr langen Kontexten mit tausenden von Token steigt der Rechenaufwand quadratisch – und wichtiger noch, die Qualität der Attention-Berechnungen lässt nach.

Das „Lost in the Middle"-Problem

Studien aus der akademischen KI-Forschung haben gezeigt, dass Sprachmodelle Informationen am Anfang und am Ende eines langen Kontexts zuverlässiger abrufen als Informationen in der Mitte. Das hat praktische Konsequenzen: Wer wichtige Anforderungen oder Constraints mitten in einem langen Chat formuliert, riskiert, dass die KI diese später ignoriert – nicht aus Böswilligkeit, sondern weil die Aufmerksamkeitsgewichtung das so ergibt.

Token-Budget-Erschöpfung

Ein weiteres Problem tritt auf, wenn das Token-Budget des Kontextfensters erschöpft ist. Je nach Implementierung passiert dann eines von zwei Dingen: Entweder wird der Chat schlicht abgebrochen und es muss ein neuer gestartet werden, oder das Modell beginnt, ältere Teile des Gesprächs „abzuschneiden" – was bedeutet, dass frühe Entscheidungen und Anforderungen nicht mehr zugänglich sind.

Praktische Strategien gegen den Kontextverlust

Auch wenn das Problem fundamentaler Natur ist, gibt es bewährte Strategien, mit denen Nutzer es in der Praxis abmildern können.

Neue Chats für neue Aufgaben: Die kontraintuitivste, aber effektivste Strategie ist schlicht, häufiger neue Chats zu starten. Statt einen einzigen riesigen Chat für ein gesamtes Projekt zu nutzen, hilft es, aufgabenbezogene Teil-Chats zu führen. Der Nachteil: Kontext muss manuell übertragen werden.

Explizite Zusammenfassungen einfordern: Nutzer können das Modell bitten, den bisherigen Diskussionsstand regelmäßig zusammenzufassen und diese Zusammenfassung dann in einen neuen Chat übertragen. Das ist aufwendig, aber es erhält die relevantesten Informationen.

Instruktionsdateien nutzen (Claude Code): Wer Claude Code einsetzt, sollte die CLAUDE.md-Funktionalität aktiv nutzen, um projektspezifisches Wissen dauerhaft zu verankern.

Codebase-Indexierung (Cursor): Bei Coding-Aufgaben bietet Cursor durch die Indexierung der Codebasis eine strukturelle Lösung, die weniger auf den Gesprächsverlauf angewiesen ist.

Wer Claude gezielt im Alltag einsetzen will, ohne in dieselbe Kontext-Falle zu tappen, findet auf vikomarketing.com einen praktischen Guide zum Claude-Einsatz im Marketing-Workflow.

Fazit: Für wen lohnt es sich?

Das Kontextfenster-Problem ist real, technisch begründet und betrifft alle aktuellen KI-Chat-Tools in unterschiedlichem Ausmaß. Die Reddit-Community, die dieses Thema diskutiert, hat Recht: Lange Chats werden schlechter – und das ist kein Bug, sondern eine Eigenschaft der zugrundeliegenden Architektur.

Für gelegentliche Nutzer ist ChatGPT nach wie vor die naheliegendste Wahl. Das Kontextfenster-Problem tritt bei kurzen bis mittellangen Gesprächen kaum auf. Wer keine stundenlangen, komplexen Sessions führt, wird den Qualitätsabfall selten bemerken.

Für Nutzer langer, komplexer Gespräche – etwa bei Rechercheprojekten, Analysen oder kreativen Projekten – bietet Claude mit seiner Kontext-Komprimierung Vorteile. Die transparentere Kommunikation über Token-Limits hilft außerdem dabei, realistischere Erwartungen zu entwickeln.

Für Entwickler und Programmierer sind Claude Code und Cursor die interessantesten Alternativen. Claude Code mit seiner CLAUDE.md-Persistenzlösung und Cursor mit der Codebase-Indexierung gehen das Problem strukturell an, anstatt nur das Kontextfenster zu vergrößern.

Die ehrliche Einschätzung: Kein aktuelles Tool löst das Problem vollständig. Wer mit langen KI-Chats arbeitet, muss entweder Strategien entwickeln (neue Chats, Zusammenfassungen, Instruktionsdateien) oder damit leben, dass die Qualität mit der Länge des Gesprächs nachlässt. Das Bewusstsein für dieses Phänomen – und nicht die Verleugnung – ist der erste Schritt zu produktiverer KI-Nutzung.

Quellen

Reddit-Diskussion: „Why do long ChatGPT chats slowly become unusable?" – r/ChatGPT, Score 6, 32 Kommentare https://reddit.com/r/ChatGPT/comments/1s989wn/why_do_long_chatgpt_chats_slowly_become_unusable/

ChatGPT (OpenAI): https://chatgpt.com

Claude (Anthropic): https://claude.ai

Claude Code (Anthropic): https://claude.ai/code

Cursor (KI-Code-Editor): https://cursor.com

Empfohlene Tools

KI-Plattform mit GPT-4o, Claude 3.5 und Gemini in einer Oberfläche. KI-Texte, Bildgenerierung und Marketing-Workflows.

Dieser Artikel enthält Affiliate-Links. Wenn du über diese Links ein Produkt kaufst oder dich anmeldest, erhalten wir eine kleine Provision — für dich entstehen keine Mehrkosten.