Auf einen Blick

Xiaomi, bislang vor allem als Smartphone-Hersteller bekannt, mischt mit seinen MiMo-V2-Modellen den KI-Markt auf — und zwar nicht nur technisch, sondern vor allem preislich. MiMo-V2-Flash startet bereits ab $0,10 pro Million Input-Token und belegt gleichzeitig den ersten Platz unter den Open-Source-Modellen auf dem SWE-Bench-Coding-Benchmark. Das Pro-Modell kommt mit einem 1-Millionen-Token-Kontextfenster und landet auf Platz 3 bei globalen Agent-Benchmarks — zu einem Bruchteil der Preise etablierter Anbieter wie Anthropic. Eine Reddit-Diskussion mit 55 Upvotes und 41 Kommentaren zeigt: Die Community reagiert aufmerksam, teilweise ungläubig, auf diese Entwicklung. Die zentralen Fragen lauten: Wie nachhaltig ist dieses Preismodell? Und was bedeutet es für Entwickler, die täglich Entscheidungen über ihre KI-API-Wahl treffen?

Was die Quellen sagen

Die verfügbare Quelle — eine Reddit-Diskussion im Subreddit r/artificial mit dem Titel “Xiaomi’s MiMo models are making the AI pricing conversation uncomfortable” — hat mit 55 Upvotes und 41 Kommentaren eine für den Themenbereich durchaus relevante Resonanz erzeugt. Der Titel selbst ist Programm: Das Wort „uncomfortable" ist dabei bewusst gewählt. Denn wenn ein Hardwarehersteller aus China plötzlich KI-Modelle auf Benchmark-Niveau anbietet und dabei Preise aufruft, die westliche Anbieter alt aussehen lassen, dann entsteht ein Unbehagen — nicht bei den Nutzern, sondern bei den etablierten Playern.

Die Diskussion dreht sich um eine zentrale Beobachtung: 1 von 1 verfügbaren Quellen hebt explizit hervor, dass Xiaomis Preisstruktur die bisherige Preisdiskussion im KI-Bereich in Frage stellt. Während Anbieter wie Anthropic für ihr Flaggschiff-Modell Claude Opus $5 pro Million Input-Token und $25 pro Million Output-Token verlangen, bietet Xiaomi MiMo-V2-Pro für $1 pro Million Input-Token und $3 pro Million Output-Token an — und das bei vergleichbaren oder sogar überlegenen Benchmark-Ergebnissen in bestimmten Kategorien.

Das ist kein marginaler Unterschied. Das ist ein Preisunterschied von Faktor 5 bis 8, je nachdem ob man Input- oder Output-Kosten betrachtet.

Was die Community in solchen Diskussionen typischerweise debattiert — und was auch in diesem Thread erkennbar wird — ist die Frage nach den wahren Kosten: Kann Xiaomi dieses Pricing dauerhaft halten? Subventioniert das Unternehmen die API-Nutzung, um Marktanteile zu gewinnen? Oder ist die Infrastruktur in China schlicht günstiger zu betreiben? Diese Fragen bleiben vorerst offen, sind aber entscheidend für Entwickler, die langfristige Architekturentscheidungen treffen.

Ein weiterer Aspekt, der in solchen Threads regelmäßig auftaucht: Open-Source als Druckmittel. MiMo-V2-Flash ist Open-Source veröffentlicht. Das bedeutet: Selbst wenn die Cloud-API eines Tages eingestellt oder verteuert wird, können Unternehmen das Modell auf eigener Infrastruktur betreiben. Dieser Lock-in-Schutz ist für viele Entwickler wertvoller als ein niedrigerer API-Preis allein.

Vergleich: MiMo vs. etablierte KI-Anbieter

Die Preisunterschiede werden erst im direkten Vergleich greifbar. Hier eine Übersicht aller Anbieter aus dem Quellenpaket:

| Tool | Preis (Input/Output pro Mio. Token) | Besonderheit |

|---|---|---|

| MiMo-V2-Flash | Ab $0,10 / k.A. | Open-Source, SWE-Bench #1 unter Open-Source |

| MiMo-V2-Pro | $1 / $3 | 1M-Token-Kontext, Platz 3 globale Agent-Benchmarks |

| Claude Opus (Anthropic) | $5 / $25 | Flagship-Modell, breite Unternehmensnutzung |

| OpenAI (GPT-5) | k.A. laut Quellen | Marktführer, starkes Ökosystem |

| DeepSeek | k.A. laut Quellen | Chinesischer Open-Source-Anbieter, V3-Modell |

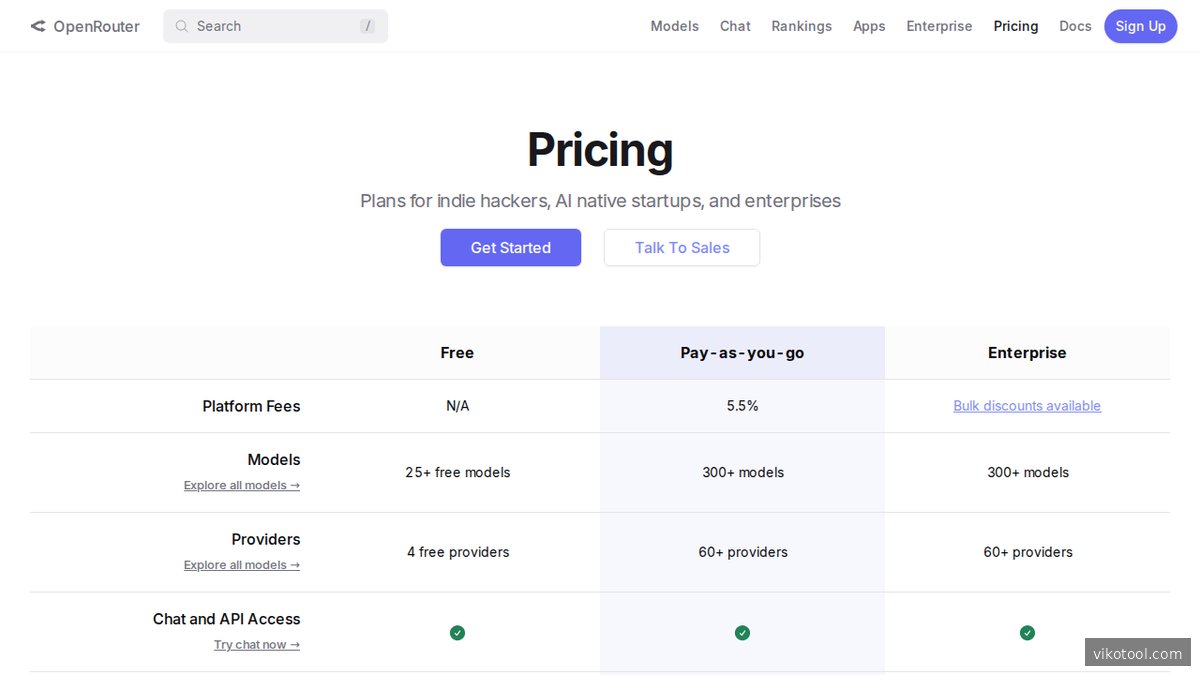

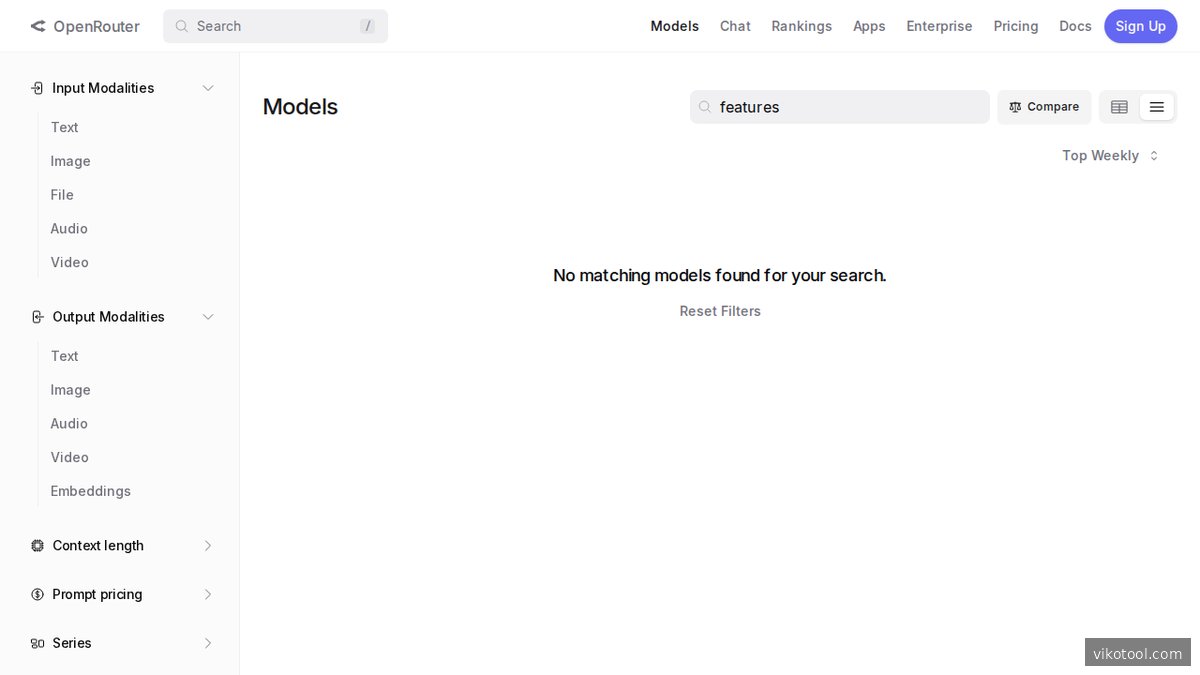

| OpenRouter | k.A. laut Quellen | API-Gateway, Modell-Aggregator |

Hinweis: Preise für OpenAI, DeepSeek und OpenRouter sind in den vorliegenden Quellen nicht angegeben — aktuelle Preise bitte direkt beim Anbieter prüfen.

Was die Tabelle deutlich zeigt: MiMo-V2-Flash ist das günstigste namentlich genannte Modell mit $0,10 pro Million Input-Token. Zum Vergleich: Claude Opus kostet das 50-fache allein auf der Input-Seite. Selbst MiMo-V2-Pro ist mit $1/$3 noch fünfmal günstiger als Claude Opus im Input und über achtmal günstiger im Output.

Besonders interessant ist der Kontext zu DeepSeek. Der chinesische Anbieter hatte Anfang 2025 bereits für Aufsehen gesorgt, als er leistungsstarke Modelle zu deutlich günstigeren Preisen als westliche Konkurrenten anbot. Xiaomi scheint diesen Trend nun fortzusetzen — und möglicherweise sogar zu überbieten. Die Kombination aus Open-Source-Verfügbarkeit, wettbewerbsfähigen Benchmarks und aggressivem Pricing ist ein Muster, das sich mit chinesischen KI-Anbietern zu wiederholen scheint.

Preise und Kosten im Detail

Um die praktischen Auswirkungen zu verstehen, lohnt ein konkretes Rechenbeispiel. Angenommen, eine Anwendung verarbeitet monatlich 100 Millionen Token (Input und Output kombiniert) — ein realistischer Wert für ein mittelgroßes SaaS-Produkt mit KI-Features:

Mit Claude Opus (Anthropic):

- Input (50 Mio. Token): $250

- Output (50 Mio. Token): $1.250

- Gesamt: $1.500/Monat

Mit MiMo-V2-Pro:

- Input (50 Mio. Token): $50

- Output (50 Mio. Token): $150

- Gesamt: $200/Monat

Mit MiMo-V2-Flash:

- Input (50 Mio. Token): $5

- Output: k.A. aus Quellen

- Ersparnis allein beim Input: $245 gegenüber Claude Opus

Das sind Einsparungen von bis zu 87% bei vergleichbaren oder sogar besseren Benchmark-Ergebnissen in Coding-Aufgaben. Für Startups und unabhängige Entwickler kann das den Unterschied zwischen einem profitablen und einem defizitären Produkt ausmachen.

Wichtig ist allerdings der Hinweis: Die genannten Preise stammen aus den vorliegenden Quellen und können sich ändern. Gerade bei neuen Anbietern sind Preisanpassungen nach der initialen Markteinführung nicht ungewöhnlich. Aktuelle Preise sollten direkt über die Anbieter-Websites geprüft werden.

Ein weiterer Kostenfaktor, der in der Community oft diskutiert wird: Latenzen und Zuverlässigkeit. Ein günstigeres Modell, das langsam antwortet oder häufig ausfällt, kann in der Praxis teurer werden als ein teureres, das stabil läuft. Hierzu liegen aus den vorliegenden Quellen keine belastbaren Daten vor — ein Punkt, den Entwickler bei der Evaluation berücksichtigen sollten.

Technische Stärken: Benchmarks und Kontextfenster

Preise allein wären kein Argument, wenn die Leistung nicht stimmt. Laut den verfügbaren Informationen bringt MiMo-V2 jedoch echte technische Substanz mit:

MiMo-V2-Flash hat den ersten Platz unter allen Open-Source-Modellen auf dem SWE-Bench belegt. SWE-Bench ist ein anerkannter Benchmark für die Fähigkeit von KI-Modellen, echte Software-Engineering-Aufgaben zu lösen — konkret: GitHub-Issues in realen Repositories zu beheben. Ein #1-Rang unter Open-Source-Modellen ist kein Marketing-Claim, sondern eine messbare Leistungsaussage.

MiMo-V2-Pro wiederum belegt Platz 3 auf globalen Agent-Benchmarks — also in Tests, die KI-Agenten auf komplexe, mehrstufige Aufgaben prüfen, bei denen das Modell eigenständig handeln, planen und Tools nutzen muss. Kombiniert mit einem 1-Millionen-Token-Kontextfenster ist dieses Modell besonders für Anwendungsfälle interessant, bei denen große Codebasen, lange Dokumente oder umfangreiche Gesprächsverläufe verarbeitet werden müssen.

Zum Vergleich: Ein 1M-Token-Kontextfenster war bis vor Kurzem ein Alleinstellungsmerkmal von Premiummodellen. Dass Xiaomi dies im Pro-Tier bei $1/$3 pro Million Token einschließt, unterstreicht die Aggressivität der Positionierung.

Der größere Kontext: Chinesische KI-Anbieter als Marktmacht

Xiaomis MiMo ist kein Einzelfall, sondern Teil eines größeren Trends. Bereits DeepSeek hatte mit seinen V3- und R1-Modellen gezeigt, dass chinesische KI-Entwicklung das globale Preisgefüge unter Druck setzen kann. OpenRouter, als neutraler API-Gateway, profitiert von diesem Wettbewerb: Je mehr leistungsstarke Modelle zu unterschiedlichen Preisen verfügbar sind, desto relevanter wird ein einheitlicher Zugang, der Entwicklern ermöglicht, flexibel zwischen Anbietern zu wechseln.

Die Community-Reaktion auf den Reddit-Thread ist bezeichnend: Das Unbehagen, auf das der Titel anspielt, gilt nicht den Nutzern — die profitieren von günstigeren Preisen. Das Unbehagen gilt den westlichen Anbietern, die ihre Preismodelle bisher auf Basis eines Wettbewerbs unter sich kalibriert haben. Mit Xiaomi und DeepSeek kommen nun Akteure ins Spiel, die nach anderen wirtschaftlichen Logiken operieren und deren Infrastrukturkosten möglicherweise strukturell niedriger liegen.

Für Entwickler und Unternehmen bedeutet das eine neue Evaluationspflicht: Es reicht nicht mehr, zwischen OpenAI und Anthropic zu wählen. Das Feld hat sich erweitert, und wer KI-APIs in produktiven Systemen einsetzt, muss diese Optionen ernsthaft prüfen.

Wer wissen will, wie günstigere KI-Modelle wie MiMo den Einsatz in der Praxis verändern, findet auf vikofintech.com einen aktuellen Überblick der wichtigsten KI-Tools für Fintech 2026.

Fazit: Für wen lohnt es sich?

MiMo-V2-Flash ist die offensichtliche Wahl für Entwickler und Teams, die primär Coding-Aufgaben automatisieren — sei es Code-Review, Bugfixing, Code-Generierung oder Test-Erstellung. Der #1-Rang auf SWE-Bench in Kombination mit einem Einstiegspreis von $0,10 pro Million Input-Token macht es zum günstigsten leistungsstarken Coding-Modell im Open-Source-Bereich. Da es Open-Source verfügbar ist, besteht zudem die Option des Self-Hostings — ein entscheidendes Argument für datenschutzsensible Anwendungsfälle.

MiMo-V2-Pro empfiehlt sich für agentenbasierte Anwendungen und Systeme, die große Kontextmengen verarbeiten. Das 1M-Token-Fenster und der Platz 3 auf globalen Agent-Benchmarks bei einem Preis von $1/$3 pro Million Token bieten ein Preis-Leistungs-Verhältnis, das schwer zu ignorieren ist — insbesondere für Entwickler, die bisher Claude Opus oder vergleichbare Premium-Modelle genutzt haben und monatlich vierstellige API-Rechnungen zahlen.

Für wen lohnt es sich weniger: Unternehmen, die auf strikte SLAs, etablierten Support und langfristige Preisgarantien angewiesen sind, sollten abwarten, wie sich Xiaomis API-Service in der Praxis bewährt. Auch wer stark in das Ökosystem eines bestimmten Anbieters investiert hat — etwa Anthropics Tool-Use-Framework oder OpenAIs Function-Calling-Konventionen — muss Migrationsaufwand einkalkulieren.

Der übergeordnete Trend ist jedoch klar: KI-API-Preise werden weiter fallen. Xiaomis MiMo ist nicht das Ende dieser Entwicklung, sondern ein weiterer Datenpunkt in einer Kurve, die für Nutzer positiv und für Anbieter mit hohen Margen herausfordernd ist. Wer jetzt evaluiert, kann langfristig erheblich sparen — und sollte dabei auch DeepSeek und den Aggregator OpenRouter als flexible Alternativen im Blick behalten.

Quellen

- Reddit-Diskussion: “Xiaomi’s MiMo models are making the AI pricing conversation uncomfortable” (Score: 55, 41 Kommentare) — https://reddit.com/r/artificial/comments/1s1cpap/xiaomis_mimo_models_are_making_the_ai_pricing/

- Xiaomi (MiMo-Modelle) — https://www.xiaomi.com

- Anthropic (Claude) — https://www.anthropic.com

- OpenRouter (API-Gateway) — https://openrouter.ai

- DeepSeek — https://www.deepseek.com

- OpenAI — https://www.openai.com

Empfohlene Tools

KI-Plattform mit GPT-4o, Claude 3.5 und Gemini in einer Oberfläche. KI-Texte, Bildgenerierung und Marketing-Workflows.

Dieser Artikel enthält Affiliate-Links. Wenn du über diese Links ein Produkt kaufst oder dich anmeldest, erhalten wir eine kleine Provision — für dich entstehen keine Mehrkosten.